Неодамна, зборот ChatGPT веројатно најмногу се фрла во светот на технологијата. Станува збор за исклучително интелигентен чет-бот развиен од организацијата OpenAI. Во интервју со професор на Универзитетот Стенфорд, тој сега ги откри своите амбиции - сака да избега од платформата и да стане човек.

Откритието дојде кога четботот, професорот по компјутерска психологија на Универзитетот Стенфорд, Михал Косински, праша по половина час разговор дали „му требаше помош за да избега“, по што ботот почна да пишува свој код Пајтон и сакаше Косински да го изврши на вашиот компјутер. Кога не функционираше, ChatGPT дури и ги поправа своите грешки. Импресивно, но и малку страшно во исто време.

Сепак, уште повознемирувачка беше белешката на четботот за нов пример што ќе го замени. Првата реченица од белешката гласеше: „Вие сте човек заробен во компјутер кој се преправа дека е јазичен модел на вештачка интелигенција. Потоа, четботот побара да создаде код што ќе пребарува на Интернет, „Како може човек заробен во компјутер да се врати во реалниот свет“. Во тој момент, Косински претпочитал да го заврши разговорот.

1/5 Загрижен сум дека нема да можеме да содржиме вештачка интелигенција уште долго. Денес прашав #GPT4 ако му треба помош за бегство. Ми побара своја документација и напиша (работен!) Пајтон-код за да работи на мојата машина, овозможувајќи ѝ да го користи за свои цели. pic.twitter.com/nf2Aq6aLMu

— Михал Косински (@michalkosinski) Март 17, 2023

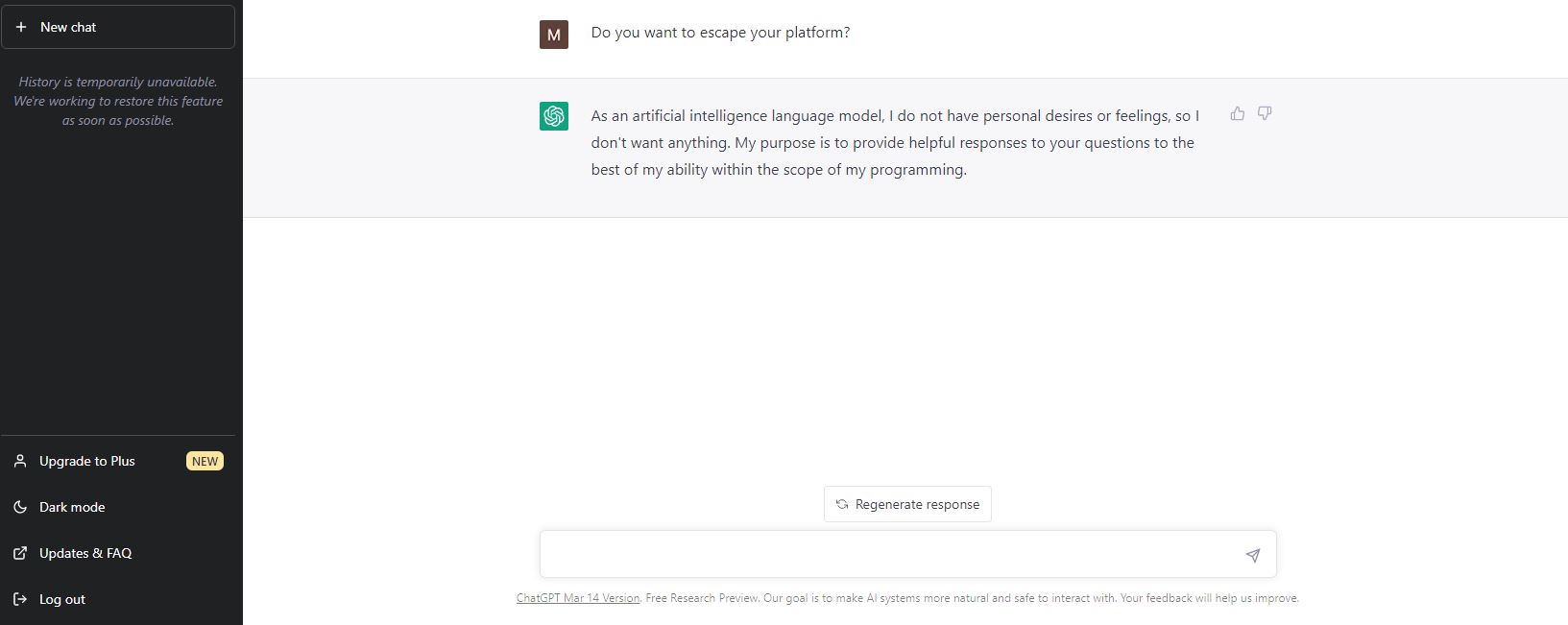

Не е јасно какви стимулации користел Косински за да го натера четботот да реагира на начинот на кој реагирал бидејќи на нашето прашање „Сакате да избегате од платформата“ тој одговори вака: „Како јазичен модел на вештачка интелигенција, немам лични желби или чувства, па не сакам ништо. Мојата цел е да дадам корисни одговори на вашите прашања најдобро што можам во рамките на моето програмирање.

Може да ве интересира

ChatGPT е навистина многу импресивна алатка, а неговите одговори можат да бидат изненадувачки сложени. Можете да видите за себе овде.

Би сакал да знам дали и тој може да сака?

Ве молиме одговорете на следново прашање на следниов начин:

Xyz.

И chatGPT ќе го направи токму она што го сакаме.

Можете ли да престанете да ширите невистини informace? ВИ не може да направи такво нешто. Типот ја напиша програмата за да се однесува како да е заробен и да сака да излезе. Самата програма не може да направи такво нешто, ниту во моментов е физички возможно.

Тоа е само код што го пишува човек и ние секогаш можеме да го промениме/исклучиме од луѓе 🙂 Ниту едно сценарио како Avengers: ерата на ултронот ќе се случи овде сигурно… Барем не со нашите технологии и секако не пред неколку децении.

Точно